- 英特尔全栈赋能,全新至强6+、网络与AI系统共筑智能体AI基石

今日,英特尔宣布数据中心领域最新进展,推出全新英特尔至强6+处理器,发布以太网800系列新成员—英特尔以太网E835控制器及网络适配器,以及AI加速器路线图的最新进展,包括Crescent Island的更多信息。这些进展共同凸显了一个清晰的行业趋势:当AI迈向智能体时代,CPU正重返现代AI基础设施的中心。

陶然 · 2026-06-01 13:54 - 算力驱动科学发现,昇腾AI4S助力科研新范式

鲲鹏昇腾开发者大会2026——昇腾AI4S技术论坛在北京成功举办。此次论坛以“算力驱动科学发现”为主题, 九大议题围绕大模型时代下AI4S智能体应用及生命科学方面的发展展开,汇聚企业、高校、科研院所多位行业专家,分享前沿理念、技术成果与落地案例,全方位探讨 AI 赋能科学研究的新方向与新路径。

陶然 · 2026-06-01 10:43 - 让未来更从容,2026戴尔科技集团春季新品品鉴会在沪启幕

日前,以“让未来更从容”为主题的2026戴尔科技集团春季新品品鉴会于上海正式启幕。在企业现代化转型持续深化的关键阶段,戴尔科技以覆盖智能商用终端与现代化企业级基础设施的全栈技术创新,系统性回应智能时代下算力迭代、效率革新、架构升级与体验进阶等企业核心需求。

陶然 · 2026-05-28 09:25 - HPE发AI智能体存储HPE Alletra Storage MP X10000

作为HPE首款AI智能体存储,HPE Alletra Storage MP X10000基于创新的解耦架构与数据智能引擎,全面重塑非结构化数据的基础设施底座,为活跃数据湖仓、大规模AI算力及极速数据恢复提供强力支撑。

陶然 · 2026-05-27 14:40 - 鲲鹏与开发者,共赢Agentic Al新时代——鲲鹏开发者峰会2026在京成功举办

鲲鹏昇腾开发者大会2026——鲲鹏开发者峰会在北京中关村国际创新中心圆满落幕。本次峰会聚焦 Agentic AI 产业变革趋势,重磅解读鲲鹏是Agentic AI时代IT基础设施的理想选择,并展示鲲鹏硬件创新、软硬协同能力与开源生态成果,为伙伴及开发者带来了一场丰盛的前沿技术盛典。

陶然 · 2026-05-23 16:52 - 一起昇腾 共绽光芒:昇腾AI开发者峰会2026在京成功举办

今日,鲲鹏昇腾开发者大会2026——昇腾AI开发者峰会2026在北京成功举办。此次峰会以“一起昇腾 共绽光芒”为主题,旨在汇聚全球前沿技术,打造面向开发者的思想盛会。昇腾秉持开源开放理念,持续为开发者提供好用易用的开发工具,着力构建繁荣的开发者生态,与每一位开发者携手共创未来。

陶然 · 2026-05-23 16:47 - 鲲鹏昇腾开发者大会2026:携手开发者共筑Agentic AI时代算力底座

以“心怀挚爱,共绽光芒”为主题的鲲鹏昇腾开发者大会2026(KADC2026)在北京中关村国际创新中心成功举办。本次大会上,昇腾、鲲鹏多项创新技术重磅发布,涵盖鲲鹏与昇腾超节点架构创新、软件开源开放及易用性持续提升等。

陶然 · 2026-05-23 16:41 - 光智共融:上海交通大学医学院联合华为打造AI F5G-A全光校园全球样板

本次发布会由上海交通大学医学院联合华为技术有限公司共同举办,会议期间,华为正式启动光智共融,AI F5G-A全光园区『领航100』先锋行动,旨在以交大医学院全场景全光校园为指引标杆,携手广大合作伙伴聚力同行,赋能教育、医疗、制造、酒店等更多行业客户,加速迈向AI园区新时代。

陶然 · 2026-05-21 21:34 - 赋能小微 智赢未来, 华为坤灵中国行2026·山东站成功举办

以“华为坤灵,助力中小企业跃升智能化”为主题的华为坤灵中国行2026・山东站,于5月19日在济南圆满举办。本次活动由华为技术有限公司主办,汇聚约300名政企客户、分销金牌伙伴、精英工程商,共探山东中小企业智能化升级的更优路径。

陶然 · 2026-05-21 14:41 - 无智联不AI,无安全不智联|华为2026星河AI网络商业峰会在深圳成功举办

今天,备受行业瞩目的华为2026星河AI网络商业峰会在深圳龙岗国际艺术中心隆重启幕。本次峰会以“无智联不 AI,无安全不智联”为主题,汇聚智慧办公、教育、医疗、零售、制造等领域的行业专家、客户代表与生态伙伴,共探AI与网络深度融合新趋势,重磅发布战略与产品矩阵,分享标杆实践,助力千行百业加速数智化转型。

陶然 · 2026-05-18 23:28 - Agent从一问一答到自主执行面临哪些挑战?

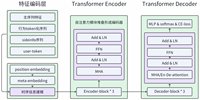

随着AI模型能力越来越强、Agent框架越来越完善,Agent正从一问一答的答疑助手,走向可以自动执行任务的数字人。Agent具备感知时间、感知事件、持续执行长链路任务的能力,可以代替人做自动化的工作。

陶然 · 2026-05-14 15:10 - 全球领先!中科曙光新一代全闪存率先突破2亿IOPS

5月13日,中科曙光正式发布FlashNexus 9000高端全闪存存储。这是继去年FlashNexus 8000以双控阵列登顶SPC-1全球第 一后,曙光再次完成的关键迭代。

陶然 · 2026-05-13 21:05 - AI手工测试用例的实践进阶之路

这篇文章分享一条真实的落地路径:我们不是直接追求“AI 一键生成完美用例”,而是先用 MVP 验证方向,再用 1.0 补齐输入解析、Prompt 工程化、知识工程和检索闭环,最后把能力沉淀到测试智能体并skill化赋能“小龙虾”。文末会给出可直接复用的实践方法与避坑点。 -- AI用例生成项目组

陶然 · 2026-05-12 09:55 - 心怀挚爱,共绽光芒——鲲鹏昇腾开发者大会2026即将启幕

当前AI以前所未有的速度蓬勃发展,模型迭代以周为单位,应用场景持续拓展,迈向Agentic AI智能体时代。在这一浪潮下,面向开发者一年一度的技术盛典——鲲鹏昇腾开发者大会 2026(KADC2026)将于5月22日-23日,在北京中关村国际创新中心举办,帮助开发者学习和使用鲲鹏、昇腾软硬件技术、平台和工具,高效自主开发和AI创新。

陶然 · 2026-05-07 16:32 - 万智互联,跃升行业智能化 | 华为全景亮相数字中国建设峰会

在第九届数字中国建设峰会期间,华为以“万智互联,跃升行业智能化”为主题参展,以四大主题论坛、九场行业分论坛、两大核心展区为载体,全面展示了华为在根技术突破与数智基础设施夯实方面的持续努力。秉持“软件开源、硬件开放”的理念,华为携手合作伙伴共建繁荣数智生态,推动前沿技术与千行百业深度融合,全方位助力数字中国各领域的建设与发展。

陶然 · 2026-04-30 16:21 - 加速城市数智创新,AI赋能高质量发展——数字中国AI CITY分论坛成功举办

4月28日晚,第九届数字中国建设峰会前夜,由华为主办的数字中国AI CITY分论坛成功举办,论坛以“加速城市数智创新,AI赋能高质量发展”为主题。活动期间,隆重发布广州人工智能融合赋能中心样板点、武汉全球城市治理数字化转型样板点等系列成果。

陶然 · 2026-04-29 21:37 - 开源鸿蒙亮相数字中国峰会丨全域使能推动生态全面提速

日前,第九届数字中国建设峰会召开前夕,鸿蒙生态峰会在福州海峡国际会展中心成功举办。峰会聚焦OpenHarmony生态建设与落地实践,来自政府机构、开放原子开源基金会及产业链上下游企业代表齐聚一堂,围绕芯片、模组、设备、行业应用等关键环节,共同探讨OpenHarmony在万物智联时代如何加速在千行百业的产业化落地和规模化应用。

陶然 · 2026-04-29 13:46 - 至强x锐炫新品发布:为AI工作站平台做加法,让专业创作从容表达

今日,英特尔公司在北京举办新一代AI工作站平台发布会,推出英特尔至强600工作站处理器与英特尔锐炫Pro B70、B65 GPU。双芯的强强联合,将为AI开发者与企业打造覆盖从日常应用和专业重负载AI应用、且颇具成本效益的高效工作平台。

陶然 · 2026-04-23 22:23 - 生成式召回在得物的落地技术分享与思考

推荐系统在提升用户体验的同时,也面临着信息茧房、兴趣收敛和内容同质化的挑战。随着用户与系统交互的深入,"推荐→用户反馈→再推荐"的闭环会逐渐强化用户的少数主兴趣,导致推荐结果趋同,降低用户的新鲜感与满意度。

陶然 · 2026-04-23 09:27 - AI翻译:出海企业如何跨越“语言鸿沟”?

目前地球上正式的语言超过了1100种,但大部分人通常只能掌握 2-3种。一旦涉及到我们不会的语言,就需要借助工具或他人来翻译。你是否好奇过,现在AI热度那么高,它能掌握其中多少语言呢?如果借助AI工具,翻译工作又是否可以完美完成?

陶然 · 2026-04-17 14:07