2026年的AI世界,正以季度为单位上演着“城头变幻大王旗”的戏码。

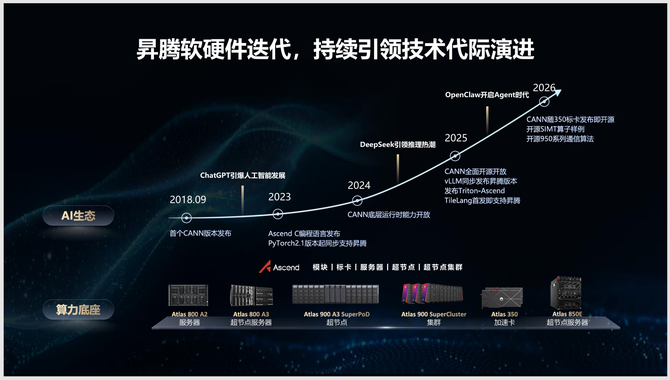

年初,OpenClaw开源框架引爆“全民养虾”热潮,AI从被动问答迈向主动生产;转眼间到4月,随着DeepSeek V4的正式发布,1M超长上下文与Agent能力的深化,让行业的目光再次聚焦于底层算力的“水位”。

与此同时,Token经济的爆发让推理算力需求呈指数级增长,一个不争的事实摆在眼前:我们正面临前所未有的“算力荒”。

在这样一个技术洪流与算力焦虑并存的时代,开发者作为创新的真正创造者,他们的体验与效率,成为了生态繁荣的“最后一公里”。从“能用”到“好用”,再从“好用”到“开发者主动选择”,昇腾似乎正在走出一条不同于简单模仿的自主生态之路。

一场关于“地基”的自我革命:CANN的全面转身

在昇腾生态沟通会上,华为昇腾专家的开场白颇为坦诚:“这一次身份变了,以前负责产品线市场,现在负责生态。”

身份转变的背后,是昇腾战略重心的迁移。过去半年多,昇腾其实只聚焦于两件事:升级开发体验,繁荣开源社区。而这所有动作的底座,都指向了那个曾被视作“黑盒”的核心软件——CANN。

华为披露了一个鲜为人知的细节:去年,当团队向公司汇报计划花一年半时间完成CANN架构解耦时,华为内部高层只给了一个期限——2025年底。最终,团队硬是用了4个月,把一年半的工程量“卷”完了。

这不是简单的华为速度展示,而是一场关于生存方式的抉择。

曾几何时,国内AI芯片的普遍思路是做兼容英伟达,即通过仿CUDA接口来降低迁移门槛。华为直言不讳地指出:“如果那样做,我们做的一切新特性,都是建立在别人的生态上,而不是为自主生态添砖加瓦。”

昇腾选择了更难的一条路:坚持底层虚拟指令集和编译器自主,上层尊重并融入国际开源生态。为此,CANN实现了组件分层解耦,代码全面开源。这意味着,开发者不再面对一个“铁板一块”的封闭系统,而是可以根据自身需求,灵活调用甚至修改从底层算子到上层应用插件的每一层。

这种把底层做厚,把体验做轻的思路,直接反映在了数据上:截至目前,CANN已拥有超过1.3万名认证开发者,社区月活超过2000人。对于一个底层基础软件而言,这个活跃度已相当可观。毕竟,作为对比,PyTorch社区的月活活跃贡献者也就在900人左右。

“Python优先”与“性能不妥协”:开发者的两难,昇腾的一次豪赌

在沟通会的展示区,我看到了一面有趣的墙,上面写着:“时代变了”。

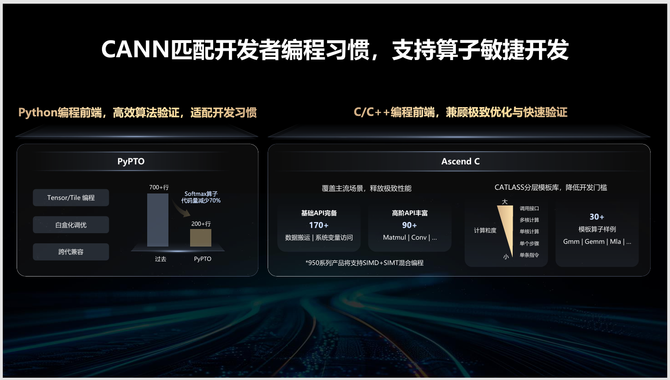

这并非一句空话。传统的AI芯片开发,深度绑定C语言,性能极致但门槛极高。而在2026年的今天,数以百万计的Python开发者才是创新的主力军。

昇腾的选择是:“尊重开发者,他们希望用Python,那就支持好Python。”

为此,CANN推出了PyPTO编程范式。这一新范式允许开发者用符合Python习惯的语法开发算子,内置的高级编译优化能自动完成流水编排与内存管理。用专家的话说:“以前手写算子需要深入硬件、反复调试,现在只需描述设计意图,昇腾的Agent会自动配置环境并生成代码。”

然而,Python的“快”与C语言的“强”在传统认知中是一对矛盾。昇腾的解法是双轨并行:Python负责灵活验证与快速上线,C语言负责底层极致性能调优。两者通过统一的中间表示层打通,既保证了开发体验,又不牺牲最终硬件的吞吐能力。

这实际上是一场豪赌——赌的是生态的力量。昇腾相信,当几万名开发者的智慧被释放,其创新能力将远胜于一家公司闭门造车。而近期DeepSeek V4的快速适配,正是这套新体系效能的初步验证。

深度绑定DeepSeek V4:昇腾超节点交出“硬核”成绩单

就在沟通会结束后的第三天,DeepSeek V4正式发布。而昇腾几乎是在同一时间宣布:昇腾超节点全系列产品全面支持DeepSeek V4系列模型。这种“发布即支持”的0day适配能力,正是昇腾生态化反的直接体现。

根据新闻稿披露的数据,基于昇腾950超节点,DeepSeek V4-Pro在8K输入场景下可实现TPOT约20ms的极低时延;而针对强调吞吐的DeepSeek V4-Flash模型,在TPOT约10ms时,单卡Decode吞吐可达1600TPS。这一性能表现,在长文本推理场景中重新定义了“天花板”。

这背后源于昇腾950代际架构的三大底层升级:原生精度加速、稀疏访存优化、增强Vector与Cube间的数据通路。这些技术名词的背后,折射出昇腾不再仅是“可用”,而是在特定场景下开始具备“好用”甚至“领先”的竞争力。

更值得关注的是,昇腾并未止步于硬件参数的堆砌。在DeepSeek V4的适配中,PyPTO编程范式的作用开始显现。针对V4引入的新的KVCache滑窗和压缩算法等复杂算子,开发周期被缩短至“天级”。这标志着昇腾的软件栈已从“追随者”开始向“能力输出者”演进。

“两个度”与“六项指标”:昇腾生态的量化野心

生态建设最怕空谈。华为提出了一个极具工程思维的框架:衡量昇腾生态成功与否,就看“两个度”——昇腾对开源社区特性的支持度,以及开源社区对昇腾特性的支持度。

为了量化这“两个度”,昇腾内部考核着六项硬指标:全量特性支持率、主流模型/算子支持率、CI/CD覆盖率、外部参与率、API一致率、资料完备率。目标是全部维持在95%以上。

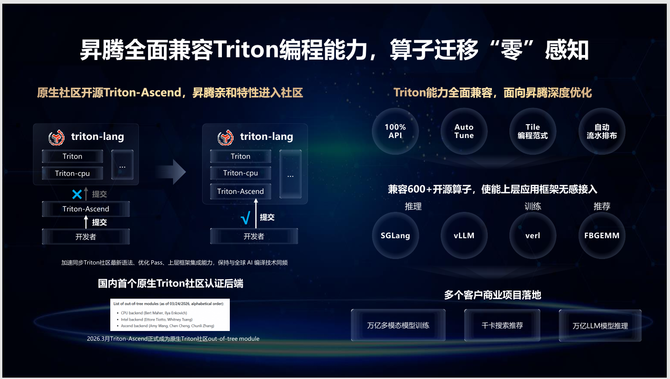

这是一个非常“不华为”的指标,因为它意味着开放与妥协。例如,为了让Triton社区接纳昇腾后端,团队花了大量时间与OpenAI沟通,最终成为国内首个Triton原生认证的后端。又比如,为了进入PyTorch的CI(持续集成)体系,让PyTorch在发布前能在昇腾硬件上跑一遍测试用例,团队经历了漫长的技术谈判。

这种“嵌入全球开源主干道”的策略,比“另起炉灶闭门造车”更具长期生命力。因为它确保了昇腾生态不会变成一个孤岛,而是全球AI创新浪潮中的一部分。

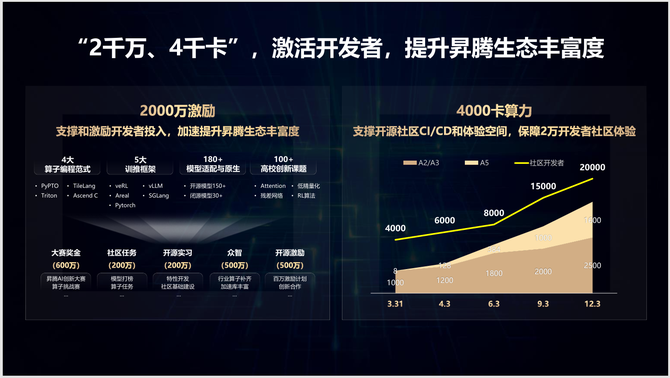

4000卡与2000万激励:让开发者成为主人

昇腾今年专门拿出了2000万创新基金,用于激励普通开发者参与算子、框架、模型适配等工作。同时,全年提供4000卡免费算力,其中超过一半是最新的950卡。

更值得玩味的是,昇腾正在通过Agent技术,将自身积累的模型迁移、调优、部署经验沉淀为开源Skills。这意味着,一个普通开发者甚至不需要成为昇腾专家,只需调用这些智能体,就能完成曾经需要华为专家驻场一周才能解决的适配工作。

这才是生态的终极形态:不是一家公司在“赋能”开发者,而是平台与开发者互相成就,共同生长。正如华为所言:“让客户成功,我们就一定能成功。他转了一圈回来说,还是你们最好。”

笔者观察:在正确的路上,卷过别人

会后,我一直在思考一个问题:在国内AI算力赛道如此拥挤的今天,昇腾的差异化到底是什么?

答案或许不是某个单项性能指标,而是一种“反直觉”的战略定力。在大家都选择“仿CUDA”这条捷径时,它选择了最难的开源自主之路;在大家都在谈“赋能”时,它放下了身段,把自己拆解成开源组件,让开发者“随便用、随便改”;在大家都在追逐下一个AI热点时,它选择用Agent和免费算力,把开发门槛降到最低。

2026年的AI竞赛,上半场是模型架构的比拼,下半场必然是开发生态和算力成本的决战。从CANN的彻底开源,到DeepSeek V4的极速适配,再到对Python开发者的无差别支持,昇腾正在用行动证明:它不再是一个需要“被扶持”的选项,而是一个正在被开发者“因为好用而选择”的新大陆。

“时代洪水冲天下,长空激浪正当时。”这场关于算力与生态的长期主义故事,才刚刚翻开新的一页。