日前,在INTERSPEECH大会上,NVIDIA展示了其对话式AI最新研究成果。开发者和创作者可使用最先进的对话式AI模型进行具有表现力的语音合成,为角色、虚拟助手和个性化形象生成声音。

如今,AI已将合成语音从单调的机器人呼叫和传统GPS导航系统转变成智能手机和智能音箱中动听的虚拟助手。

但AI合成语音与我们在日常对话和媒体中听到的人类语音之间仍有差距。这是因为人在说话时会有复杂的节奏、音调和音色,而AI很难在这些方面进行模仿。

但这一差距正在迅速缩小。NVIDIA研究人员正在创建高质量、可控制的语音合成模型和工具,这些模型和工具能够捕捉人类语音的丰富性,并且不会出现音频杂音。NVIDIA研究人员目前正在INTERSPEECH 2021大会上展示他们的最新项目。本届大会将持续到9月3日。

据了解,这些模型有助于为银行和零售商的自动客户服务热线配音、使视频游戏和书籍中的人物变得栩栩如生,并为数字化身提供实时语音合成。

NVIDIA的内部创意团队甚至使用该技术为一个关于AI力量的系列视频制作了动人的解说。

情感语音合成只是NVIDIA研究院在对话式AI领域的重点工作之一。该领域还包括自然语言处理、自动语音识别、关键词检测、音频增强等。

这些前沿工作经过优化后可以在NVIDIA GPU上高效运行,其中的一些工作已经通过NVIDIA NeMo工具包开放源代码,可在NVIDIA NGC容器和其他软件中心获得。

I AM AI幕后花絮

NVIDIA研究人员和专业创作人员并不是在针对对话式AI进行纸上谈兵。他们通过身体力行,将突破性的语音合成模型应用于I AM AI系列视频中。该系列视频介绍了重塑各个行业的全球AI创新者。

不久之前,这些视频还都是由人类配音的。以前的语音合成模型对合成声音节奏和音调的控制十分有限,因此AI配音无法唤起观众的情感反应,只有富有感情的人类声音才能做到这一点。

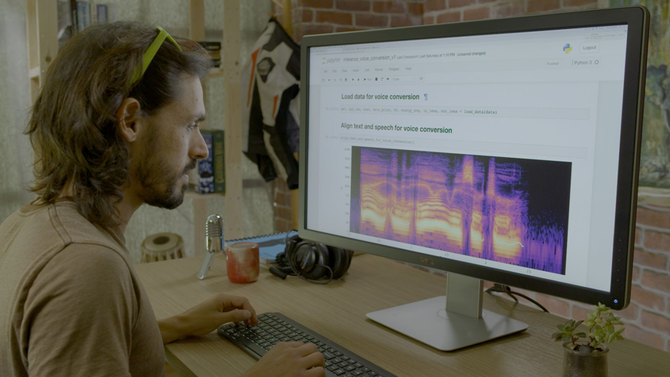

在过去的一年中,NVIDIA文本-语音研究团队开发出更强大、更可控的语音合成模型(如RAD-TTS),使得上述情况发生了变化。NVIDIA在SIGGRAPH Real-Time Live比赛中的获奖演示就采用了这个模型。通过使用人类语音音频来训练文本-语音模型,RAD-TTS可以将任何文本转换成说话人的声音。

该模型的另一项功能是语音转换,即使用一名说话人的声音讲述另一名说话人的话语(甚至歌唱)。RAD-TTS界面的灵感来自于将人的声音作为一种乐器这一创意。用户可以使用它对合成声音的音调、持续时间和强度进行精细的帧级控制。

通过这个接口,视频制作者可以在录制中自行阅读视频文本,然后使用AI模型将他作为男叙述者的语音转换成女叙述者的声音。制作者可以使用这个基准叙述,像指导配音演员一样指示AI,比如通过调整合成语音来强调特定的词语、修改叙述节奏以更好地表达视频中的语气等。

该AI模型的能力已超出了配音工作的范围:文本-语音转换可以用于游戏、为有声音障碍的人提供帮助、或帮助用户用自己的声音进行不同语言的叙述。它甚至可以重现标志性歌手的表演,不仅能够匹配歌曲的旋律,还能匹配人声背后的情感表达。

为AI开发者和研究者提供强大的语音功能

NVIDIA NeMo是一款用于GPU加速对话式AI的开源Python工具包。研究者、开发者和创作者通过使用该工具包,能够在自己的应用实验和和微调语音模型方面取得先机。

NeMo中易于使用的API和预训练模型能够帮助研究人员开发和自定义用于文本-语音转换、自然语言处理和实时自动语音识别的模型。其中几个模型是在NVIDIA DGX 系统上使用数万小时的音频数据训练而成。开发者可以根据自己的使用情况对任何模型进行微调,运用NVIDIA Tensor Core GPU上的混合精度计算加快训练速度。

NVIDIA NeMo还通过NGC提供在Mozilla Common Voice上训练的模型,该数据集拥有76种语言、近14000小时的众包语音数据。该项目的目标是在NVIDIA的支持下,通过全球最大的开源数据语音数据集实现语音技术的普及化。

语音技术的盛宴:NVIDIA研究人员展示AI语音技术的最新进展

INTERSPEECH汇聚了1000多名研究人员,他们展示了语音技术方面的突破性进展。在本周的会议上,NVIDIA研究院将展示对话式AI模型架构以及供开发者使用的完全格式化语音数据集。